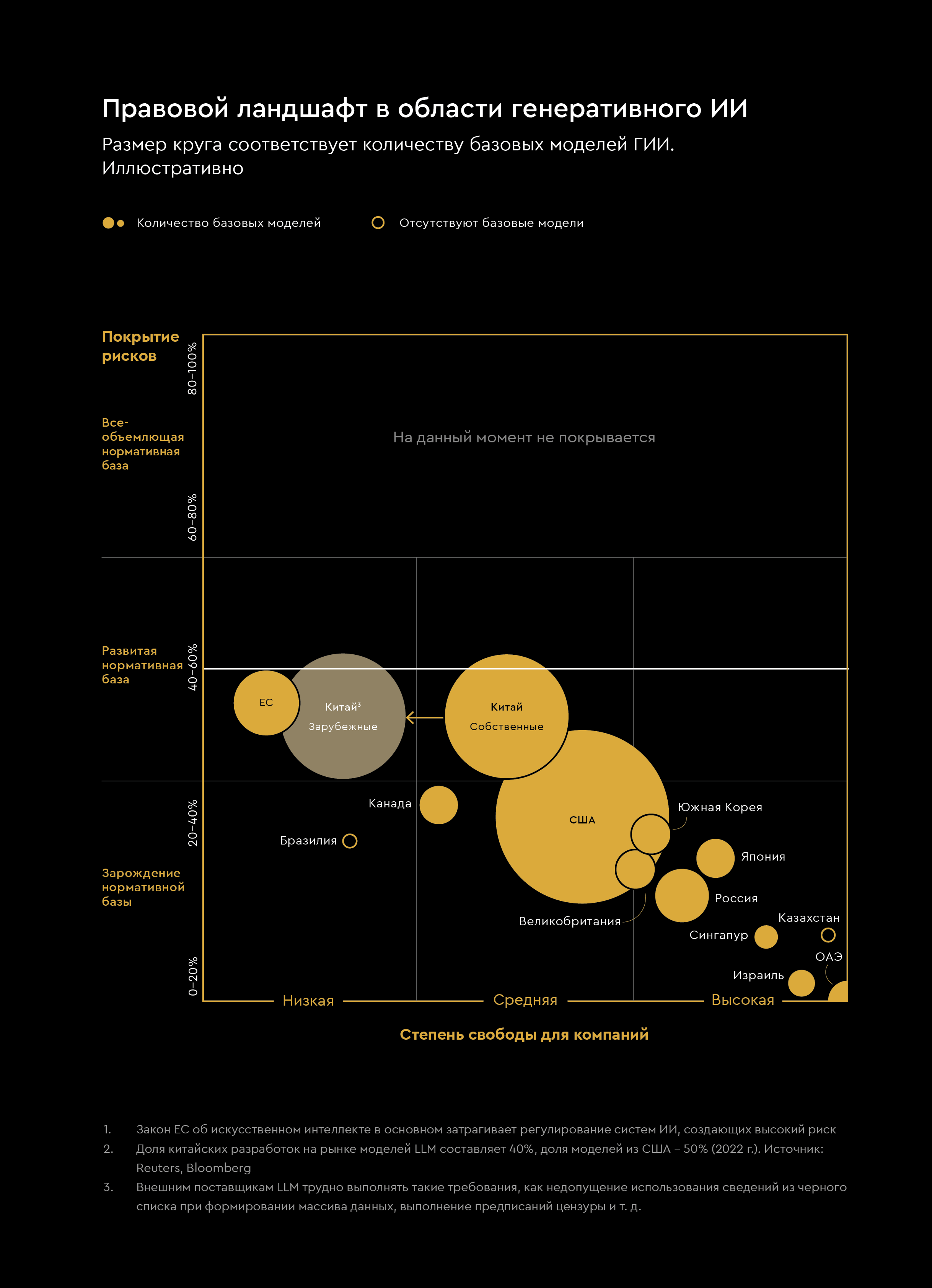

Аналитики «Яков и Партнёры» и Альянса в сфере искусственного интеллекта определили наиболее благоприятные страны для развития технологий искусственного интеллекта. По итогам анализа они распределили страны по нескольким группам в зависимости от уровня зрелости нормативной базы и степени свободы для компаний — разработчиков ГИИ. К первой группе лидеров отнесли: США, Израиль, Сингапур, ОАЭ и Россию — в этих странах созданы наиболее благоприятные условия, способствующие развитию ИИ и привлечению инвестиций. Во вторую группу вошел Китай, который одновременно использует две модели: создает более комфортные условия для своих разработчиков и барьеры по выходу на внутренний рынок зарубежных поставщиков. В третью — ЕС, Канада и Бразилия. Последние страны ставят целью максимальное снижение потенциальных рисков от внедрения и использования технологии, что создает существенные препятствия для развития ГИИ.

Исследование показало, что на данный момент ни в одной из стран нормативно-правовая база не покрывает весь жизненный цикл сервисов на основе ГИИ — от разработки и обучения моделей до использования конечных ответов ИИ. Это обусловлено тем, что нет общепринятых правил митигации рисков, поэтому страны постепенно вводят и тестируют требования на тех этапах, которые считают для себя рисковыми.

Помимо этого, в ходе исследования был проведен анализ произошедших в мире инцидентов с участием ГИИ и выделены пять самых релевантных рисков, которые связаны с развитием генеративных ИИ-технологий: рост объема некачественного контента, сгенерированного ГИИ; потенциальный вред от ложных ответов ГИИ; негативное влияние на рынок труда; цифровое мошенничество; нарушение этических норм.

Аналитики подчеркивают, что большинство рисков можно минимизировать за счет маркировки генеративного контента, в том числе скрытой, создания сервисов для проверки наличия сгенерированных элементов и ответственного отношения к работе с технологией. В частности, в 2023 г. семь иностранных компаний (Amazon, Anthropic, Google, Inflection, Meta, Microsoft и OpenAI) договорились о разработке и внедрении инструментов в области ответственного ИИ. В перечень этих обязательств входят в том числе маркировка сгенерированного контента и тестирование безопасности разработанных решений.

В России на уровне отрасли также развивается саморегулирование. В 2021 г. компании — участники Альянса в сфере искусственного интеллекта подписали Кодекс этики в сфере ИИ, который в этом году был расширен декларацией об ответственной разработке и использовании сервисов на основе генеративного ИИ.

Помимо прочего, для минимизации рисков необходимо повышение цифровой и правовой грамотности населения: информирование о рисках и возможностях генеративного ИИ, особенностях и ответственности за использование данной технологии. Пользователям также следует критически воспринимать контент, сгенерированный ИИ.

Учитывая опыт зарубежных стран и темпы развития ИИ в России, наиболее оптимальным представляется механизм саморегулирования, который сохраняет баланс между введением регуляторных правил и возможностями для развития технологий. Одной из частей такого подхода может стать постоянный мониторинг ситуации вокруг развития генеративного искусственного интеллекта в РФ и сбор обратной связи от пользователей, чтобы на ее основе улучшать их качество и правовые нормы, регулирующие работу сервисов. На первом этапе изменения на основе полученной информации могут быть отражены через дополнения, внесенные в российскую декларацию об ответственной разработке и использовании сервисов на основе генеративного ИИ.

Позже протестированные механизмы могут стать основой для разработки экспериментальных правовых режимов в области генеративного ИИ.